Forklarbar kunstig intelligens

- Avdeling Statistisk modellering og maskinlæring

- Involverte fagområder Maskinlæring

Det kan være vanskelig å forstå hva maskinlæring og kunstig intelligens legger vekt på, og hvordan automatiserte avgjørelser tas. Derfor utvikler vi metoder for såkalt forklarbar kunstig intelligens (XAI). Forklarbar kunstig intelligens, eller Explainable Artificial Intelligence på engelsk, handler om å se inn i den svarte boksen. Med bedre innsikt kan vi kvalitetssikre automatiserte beregninger og produsere riktige forklaringer.

Hvordan velge riktig XAI-metode

En av de sentrale utfordringene er å kunne gi forståelige forklaringer på hvordan systemer basert på maskinlæring og kunstig intelligens kommer fram til prediksjoner eller beslutninger. I de siste årene har det blitt utviklet en myriade av slike metoder, men ikke alle er nyttige eller riktige.

NR har derfor utviklet verktøyet eXplego som skal gjøre det lettere å navigere i dette landskapet. eXplego er et digitalt beslutningstre med interaktiv veiledning som skal bistå utviklere til å velge passende XAI-metode.

Kontrafaktiske forklaringer og Shapley-verdier

Vi har jobbet spesielt med to klasser av forklaringer:

- Kontrafaktiske forklaringer

- Shapley-verdier

Kontrafaktiske forklaringer ser på hva som må til for å få et alternativt utfall dersom noe av det som går inn i modellen hadde vært annerledes, for eksempel om din inntekt hadde vært lavere eller høyere.

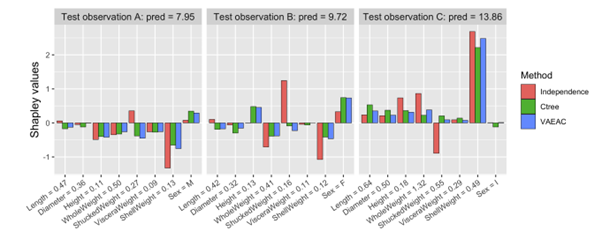

Shapley-verdier basert på spillteori og tar sikte på å fordele betydningen av det som går inn i modellen på en rettferdig måte.

Uansett forklaringsmetodikk, er vi opptatt av at forklaringene vi lager er riktige.

En fordel med statistikkfaglig kompetanse

En praktisk utfordring er at variabler som går inn i en maskinlæringsmodell som regel ikke er uavhengige, mens en del anerkjente forklaringsmetoder antar uavhengighet. Eksempelvis vil din inntekt ofte ha sammenheng med hvor gammel du er. Likevel er det mange forklaringsmetoder som ikke tar høyde for dette. Ved å ta hensyn til denne avhengigheten på en realistisk måte, kan vi gi riktige forklaringer på hvordan en maskinlæringsmodell oppfører seg. Vår statistikkfaglige kompetanse er en stor fordel i denne sammenhengen.

Utvalgte prosjekter innen forklarbar kunstig intelligens

Vil du vite mer om vårt arbeid innen forklarbar kunstig intelligens?

Ta kontakt.

Noen av våre samarbeidspartnere

- NAV

- Gjensidige

- FundingPartner

- Universitetet i Oslo

Aktuelle lenker